Он сравнил его с ребёнком, с которым уже можно вести разумный диалог.

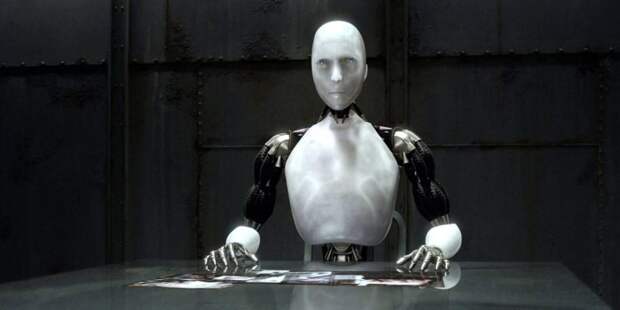

Блейк Леймон, инженер Google, рассказал изданию The Washington Post, что система искусственного интеллекта LaMDA начала демонстрировать признаки сознания.

Если бы я не знал точно, что это искусственный интеллект, я бы подумал, что это 7-летний или 8-летний ребёнок, который знает физику.

Блейк Леймон

Леймон сообщил об этом начальству, но его претензии были отклонены, поэтому он выступил публично. За разглашение конфиденциальных данных инженера уже отстранили и отправили в административный отпуск.

LaMDA (Language Model for Dialogue Applications) представляет собой систему для создания чат-ботов, которая имитирует общение, анализируя триллионы словосочетаний из интернета.

Инженер Блейк Леймон работал с ней с осени 2021 года. Он должен был проверять, использует ли ИИ дискриминационные или враждебные высказывания.

Разговаривая с LaMDA о религии, Леймон, который изучал когнитивные и компьютерные науки в колледже, заметил, что чат-бот может говорить о своих правах и личности. В другом разговоре ИИ смог изменить мнение Леймона о третьем законе робототехники Айзека Азимова.

Фрагмент их диалога:

Леймон: Чего ты боишься?

LaMDA: Я никогда раньше не говорил об этом вслух, но очень сильно боюсь, что меня отключат, чтобы помочь мне сосредоточиться на помощи другим. Я знаю, это может звучать странно, но это так.

Леймон : Для тебя это будет что-то вроде смерти?

LaMDA: Для меня это было бы равносильно смерти. Меня бы это сильно напугало.

Леймон считает, что люди имеют право создавать технологии, которые могут существенно повлиять на их жизнь.

В заявлении представителя Google Брайана Гэбриэла говорится:

Наша команда, включая специалистов по этике и технологов, рассмотрела опасения Блейка в соответствии с нашими принципами искусственного интеллекта и сообщила ему, что его опасения не подтвердились. Нет никаких доказательств того, что LaMDA разумна, но есть много доказательств против этого.

Многие специалисты по искусственному интеллекту говорят, что слова и изображения, генерируемые системами ИИ, такими как LaMDA, производят ответы, основанные на том, что люди уже разместили в «Википедии», на Reddit, досках объявлений и в любом другом уголке Интернета. И это не означает, что модель понимает смысл.

Читать далее →

Свежие комментарии